A medida que los robots avanzan desde las fábricas cerradas hacia nuestros hospitales, hogares, calles y campos de batalla, surgen complejos dilemas éticos que desafían nuestros marcos morales tradicionales. La robótica no solo plantea preguntas técnicas sobre lo que las máquinas pueden hacer, sino también interrogantes fundamentales sobre lo que deberían hacer y cómo su integración en la sociedad transformará nuestra comprensión de la responsabilidad, la autonomía y la dignidad humana.

El Despertar de la Conciencia Ética en Robótica

Durante décadas, la robótica se desarrolló principalmente como un desafío técnico, centrándose en crear máquinas que pudieran realizar tareas físicas cada vez más complejas. Sin embargo, tres factores clave han catalizado una nueva era de reflexión ética:

Autonomía Creciente

La evolución desde robots estrictamente programados hacia sistemas con capacidad de aprendizaje y toma de decisiones autónomas ha difuminado las líneas de responsabilidad:

- Robots que toman decisiones basadas en algoritmos de aprendizaje cuyos procesos internos pueden ser opacos incluso para sus creadores.

- Sistemas que pueden adaptarse a circunstancias imprevistas sin intervención humana directa.

- Máquinas capaces de establecer sus propios subobjetivos para alcanzar metas generales asignadas por humanos.

Interacción Social

A diferencia de las herramientas tradicionales, los robots modernos están diseñados para relacionarse con personas de maneras cada vez más sofisticadas:

- Asistentes sociales que establecen relaciones emocionales con usuarios vulnerables como niños o ancianos.

- Robots de cuidado que deben tomar decisiones con implicaciones para el bienestar y la dignidad de los pacientes.

- Interfaces que imitan comportamientos humanos, generando expectativas y respuestas psicológicas complejas.

Ubicuidad e Impacto

La expansión de la robótica a prácticamente todos los ámbitos de la vida amplifica su impacto social:

- Transformación de mercados laborales con desplazamiento de categorías enteras de empleo.

- Sistemas de seguridad y vigilancia robótica que plantean cuestiones sobre privacidad y libertades civiles.

- Vehículos autónomos que deben "decidir" en fracciones de segundo en situaciones potencialmente letales.

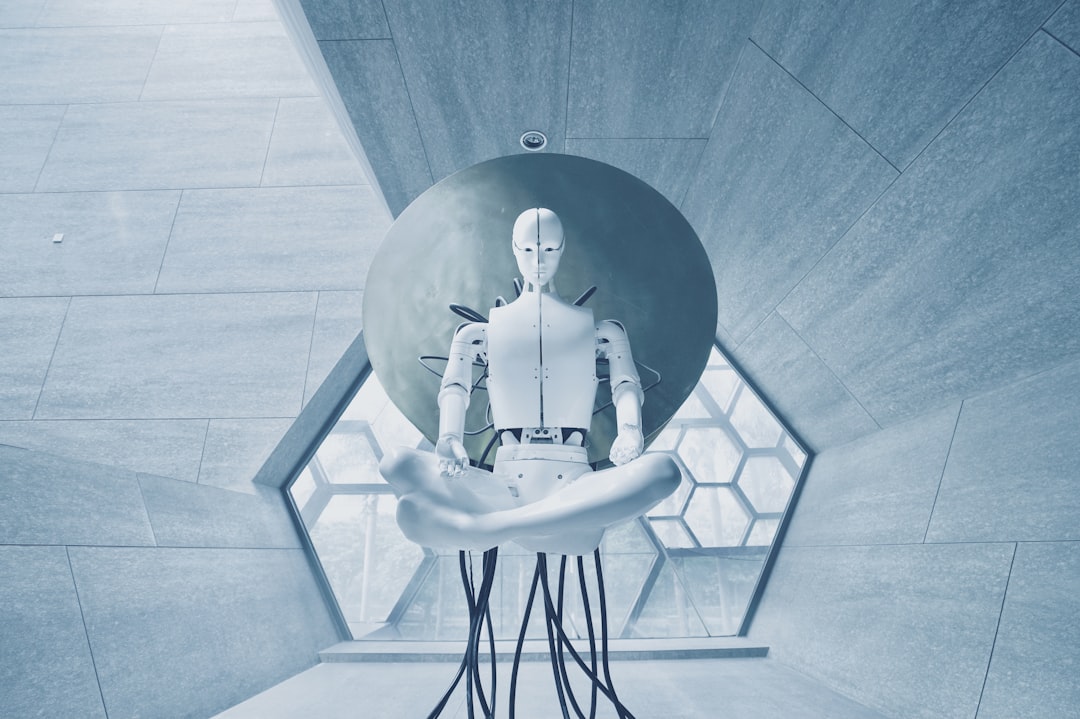

La integración de robots en espacios sociales plantea nuevas preguntas éticas sobre cuidado, confianza y engaño

"La robótica nos obliga a hacer explícitos valores y principios éticos que antes permanecían implícitos en nuestras interacciones puramente humanas. Al programar máquinas autónomas, debemos codificar la moralidad de una manera que nunca antes habíamos necesitado articular."

— Dr. Pedro Domingos, especialista en ética aplicada a la tecnología

Dilemas Éticos Fundamentales

A medida que la robótica avanza, emergen varios dilemas éticos centrales que desafían nuestros marcos morales tradicionales:

Responsabilidad y Agencia Moral

Cuando los robots toman decisiones autónomas, ¿quién es responsable de las consecuencias?

- La cadena de responsabilidad: ¿Recae en los programadores, fabricantes, propietarios, operadores o en el propio sistema?

- Responsabilidad distribuida: ¿Cómo asignar culpabilidad cuando intervienen múltiples actores y sistemas complejos?

- Agencia moral de las máquinas: ¿Pueden o deberían los robots muy avanzados ser considerados agentes morales con algún tipo de responsabilidad propia?

Transparencia y Explicabilidad

A medida que los sistemas robóticos se vuelven más complejos, surge la paradoja de que las decisiones más importantes pueden ser las menos comprensibles:

- Cajas negras algorítmicas: Sistemas de aprendizaje profundo cuyos procesos internos resultan opacos incluso para sus diseñadores.

- Derecho a explicación: ¿Tienen las personas afectadas por decisiones robóticas derecho a entender cómo se tomaron esas decisiones?

- Tensión entre rendimiento y explicabilidad: Los sistemas más eficaces suelen ser los menos transparentes, creando un dilema entre optimización y rendición de cuentas.

Caso de Estudio: El Dilema del Tranvía Robótico

El "problema del tranvía" se ha convertido en un marco de referencia para discutir la ética de los vehículos autónomos. Cuando un accidente es inevitable, ¿debería un vehículo autónomo priorizar salvar a sus pasajeros o minimizar el daño total, incluso si eso significa sacrificar a quienes transporta? Un estudio global realizado por el MIT en 2018 reveló profundas diferencias culturales en las expectativas morales sobre estas decisiones, ilustrando la dificultad de establecer estándares éticos universales para la robótica.

Engaño y Manipulación

Los robots sociales y asistentes plantean cuestiones sobre autenticidad e influencia:

- Falsa apariencia de empatía: Sistemas diseñados para simular emociones y comprensión que no poseen realmente.

- Manipulación optimizada: Robots que aprovechan sesgos psicológicos humanos para maximizar su influencia o aceptación.

- Engaño terapéutico: ¿Es ético utilizar robots que generan apego emocional en poblaciones vulnerables como ancianos o niños con autismo?

Privacidad y Vigilancia

Los robots son inherentemente sistemas de recolección de datos:

- Sensores omnipresentes: Robots equipados con cámaras, micrófonos y otros sensores que capturan información constantemente en espacios privados.

- Datos íntimos: Asistentes domésticos y de cuidado que acceden a información altamente personal y sensible.

- Consentimiento contextual: Dificultad para obtener consentimiento significativo cuando los robots operan en espacios compartidos o públicos.

Autonomía y Dignidad Humana

La automatización plantea cuestiones sobre el control y la agencia humana:

- Paternalismo tecnológico: Sistemas que limitan opciones "por nuestro propio bien" basados en algoritmos que predicen lo que es mejor para nosotros.

- Erosión de capacidades: Dependencia de máquinas que puede atrofiar habilidades humanas fundamentales.

- Dignidad en el cuidado: Equilibrio entre eficiencia y humanidad en entornos médicos y asistenciales.

"El mayor peligro no es que las máquinas piensen como humanos, sino que los humanos comiencen a pensar como máquinas, reduciendo la rica complejidad de la experiencia humana a aquello que puede ser cuantificado y optimizado."

— Dra. Isabel Moreno, filósofa especializada en ética tecnológica

Marcos Éticos para la Robótica

Para abordar estos dilemas, diversos enfoques éticos están emergiendo, cada uno con sus fortalezas y limitaciones:

Ética Basada en Reglas y Principios

Inspirado en las Tres Leyes de la Robótica de Asimov, este enfoque busca establecer principios fundamentales:

- Principios de Asilomar para IA: Directrices desarrolladas por investigadores para garantizar que los sistemas de IA operen de manera segura y beneficiosa.

- Principio de beneficencia: Los robots deben diseñarse para beneficiar a los humanos y no causarles daño.

- Principio de autonomía: Los humanos deben mantener el control significativo sobre los sistemas robóticos.

Sin embargo, este enfoque enfrenta desafíos cuando los principios entran en conflicto o requieren interpretación contextual que los sistemas autónomos pueden no manejar adecuadamente.

Ética Consecuencialista y Utilitaria

Centrada en optimizar resultados medibles:

- Cálculo de utilidad: Programar robots para maximizar el bienestar general y minimizar el daño.

- Análisis costo-beneficio: Evaluar sistemáticamente los impactos positivos y negativos de las decisiones robóticas.

- Optimización con restricciones: Maximizar objetivos dentro de límites éticos inviolables.

Este enfoque ofrece claridad computacional, pero plantea preguntas sobre cómo cuantificar valores humanos y si ciertos principios deberían ser inviolables independientemente de las consecuencias.

Ética de las Virtudes y del Cuidado

Inspirada en tradiciones filosóficas centradas en el carácter y las relaciones:

- Robots como extensión de virtudes humanas: Diseñar sistemas que reflejen y promuevan valores como compasión, justicia y prudencia.

- Ética del cuidado: Priorizar las relaciones y necesidades particulares sobre reglas abstractas y universales.

- Aprendizaje moral: Sistemas que pueden desarrollar sensibilidad ética a través de experiencia y retroalimentación.

Este enfoque reconoce la importancia del contexto y las relaciones, pero presenta desafíos significativos para su implementación computacional.

La ética del cuidado robótico equilibra eficiencia tecnológica con valores humanos fundamentales como dignidad y autonomía

Diseño Centrado en Valores

Un enfoque que integra consideraciones éticas desde el inicio del proceso de diseño:

- Identificación explícita de valores: Articular qué valores humanos debe preservar y promover el sistema.

- Participación de stakeholders: Involucrar a diversas partes interesadas, incluidos usuarios finales, en decisiones de diseño ético.

- Evaluaciones de impacto ético: Análisis sistemáticos de posibles consecuencias éticas antes de la implementación.

Este enfoque proactivo puede prevenir problemas, pero requiere procesos de desarrollo más lentos y complejos.

Desafíos Prácticos y Regulatorios

Trasladar principios éticos a la práctica presenta numerosos desafíos:

Gobernanza y Regulación

El panorama regulatorio está evolucionando rápidamente pero de manera desigual:

- Marcos regulatorios emergentes: La Unión Europea lidera con su propuesta de Ley de IA, categorizando aplicaciones robóticas según niveles de riesgo.

- Autorregulación industrial: Códigos de conducta y estándares voluntarios desarrollados por empresas e investigadores.

- Desafíos jurisdiccionales: Dificultad para establecer normas globales en un contexto de competencia geopolítica por el liderazgo tecnológico.

Implementación Técnica de Principios Éticos

Traducir conceptos éticos abstractos a código ejecutable plantea retos fundamentales:

- Alineación de valores: Técnicas para asegurar que sistemas de aprendizaje automático interioricen valores humanos.

- Explicabilidad por diseño: Arquitecturas que permiten comprender y auditar decisiones algorítmicas.

- Evaluación ética: Metodologías para probar y verificar el comportamiento ético de sistemas robóticos.

Diversidad Cultural y Relativismo Ético

Las expectativas éticas varían significativamente entre culturas:

- Variaciones interculturales: Diferentes prioridades y expectativas éticas según contextos culturales.

- Universalismo vs. particularismo: Tensión entre establecer estándares éticos globales y respetar diversidad cultural.

- Localización ética: Adaptación de sistemas robóticos a normas y expectativas locales.

Iniciativas Notables

El IEEE (Instituto de Ingenieros Eléctricos y Electrónicos) ha desarrollado la iniciativa "Ethically Aligned Design", un marco exhaustivo para el desarrollo ético de sistemas autónomos e inteligentes. Esta iniciativa involucra a miles de expertos globales para establecer estándares que prioricen el bienestar humano en el diseño de tecnologías robóticas, abordando aspectos desde transparencia algorítmica hasta consideraciones de privacidad y seguridad.

Casos Específicos de Dilemas Éticos

Para comprender mejor la complejidad de estos desafíos, examinemos algunos contextos específicos:

Robótica Militar y Armas Autónomas

Quizás el ámbito más controvertido de la ética robótica:

- Sistemas de armas autónomas letales: Robots capaces de seleccionar objetivos y aplicar fuerza letal sin intervención humana directa.

- Campaña "Stop Killer Robots": Movimiento internacional que aboga por la prohibición preventiva de armas completamente autónomas.

- Control humano significativo: Debate sobre qué nivel de supervisión humana es necesario para decisiones letales.

- Responsabilidad en conflictos: Problemas para aplicar leyes de guerra cuando intervienen sistemas autónomos.

Cuidado de Salud Robótico

Un campo donde las consideraciones éticas son particularmente sensibles:

- Triaje automatizado: Sistemas que priorizan pacientes en situaciones de recursos limitados.

- Robots de compañía para adultos mayores: Dilemas sobre engaño emocional y sustitución de contacto humano genuino.

- Autonomía del paciente: Equilibrio entre asistencia automatizada y respeto a las decisiones personales de salud.

- Confidencialidad médica: Gestión de información sanitaria altamente sensible por sistemas conectados.

Vehículos Autónomos

Un caso de estudio paradigmático en ética robótica:

- Dilemas de distribución de riesgos: Cómo programar respuestas a situaciones donde algún daño es inevitable.

- Transparencia de algoritmos: Derecho de usuarios y público a comprender cómo se toman decisiones críticas.

- Sesgos en sistemas de seguridad: Riesgos de que sistemas de reconocimiento funcionen de manera desigual para diferentes grupos demográficos.

- Responsabilidad legal: Evolución de marcos de seguro y responsabilidad civil adaptados a vehículos sin conductor humano.

Robots Sociales y Compañeros

Sistemas diseñados específicamente para interacción emocional:

- Apego psicológico: Implicaciones de formar vínculos emocionales con máquinas.

- Infantilización: Riesgos de que robots de cuidado traten a adultos de manera paternalista o infantilizante.

- Diseño de personalidad: Consideraciones éticas al crear temperamentos artificiales y patrones de comportamiento.

- Representación de género y diversidad: Perpetuación o desafío de estereotipos sociales en el diseño de robots humanoides.

"Nuestros robots reflejan quiénes somos y quiénes aspiramos a ser. La forma en que diseñamos, desplegamos y regulamos estas tecnologías revela nuestros verdaderos valores como sociedad, más allá de lo que decimos defender."

— Prof. Alejandro Ramírez, especialista en ética robótica

Hacia una Ética Robótica Integrada

A medida que avanzamos, varias direcciones prometedoras están emergiendo para abordar estos desafíos éticos:

Ética desde el Diseño

Integrar consideraciones éticas desde las primeras etapas de desarrollo:

- Marcos de evaluación ética que forman parte del ciclo de vida del desarrollo de productos.

- Equipos multidisciplinarios que incluyen especialistas en ética, ciencias sociales y humanidades junto a ingenieros.

- Procesos de diseño participativo que involucran a diversos stakeholders, especialmente usuarios finales y comunidades afectadas.

Educación y Alfabetización

Preparar a creadores y usuarios para un mundo robótico:

- Reforma de planes de estudio en ingeniería y ciencias de la computación para integrar consideraciones éticas.

- Educación pública sobre capacidades y limitaciones reales de la robótica para contrarrestar tanto miedos infundados como expectativas irrealistas.

- Formación de profesionales en campos donde se implementan robots (salud, educación, seguridad) sobre consideraciones éticas específicas.

Gobernanza Adaptativa y Colaborativa

Desarrollar marcos regulatorios flexibles y participativos:

- Sandboxes regulatorios que permiten experimentación controlada con nuevas tecnologías bajo supervisión.

- Participación de múltiples actores en el desarrollo de estándares y normativas.

- Mecanismos de revisión periódica que pueden adaptarse a tecnologías emergentes y consecuencias imprevistas.

Investigación Interdisciplinaria

Profundizar nuestra comprensión de las implicaciones de la robótica:

- Estudios empíricos sobre efectos psicológicos y sociales de la interacción humano-robot a largo plazo.

- Desarrollo de metodologías para evaluar y verificar comportamiento ético en sistemas autónomos.

- Investigación sobre traducción de principios éticos abstractos a implementaciones técnicas específicas.

Conclusión: Robots como Espejo de Nuestra Humanidad

Los desafíos éticos que plantea la robótica no son meramente técnicos, sino profundamente filosóficos y sociales. Las máquinas que creamos nos obligan a reflexionar sobre nuestra propia naturaleza: qué valoramos, cómo tomamos decisiones morales, qué significa ser humano en un mundo cada vez más automatizado.

La historia de la tecnología nos enseña que rara vez podemos predecir con precisión todas las consecuencias de nuestras innovaciones. Sin embargo, podemos comprometernos con un proceso de desarrollo tecnológico que priorice el bienestar humano, respete la dignidad y autonomía de las personas, y permanezca abierto a la adaptación continua a medida que aprendemos.

En última instancia, los robots no plantean tanto una crisis ética nueva como un espejo que refleja y amplifica dilemas morales que siempre han existido en nuestras sociedades. La forma en que abordemos estos desafíos no solo definirá el futuro de la robótica, sino que revelará mucho sobre nuestros propios valores y prioridades como civilización.

El camino hacia una integración ética de la robótica en nuestras vidas requerirá humildad, colaboración interdisciplinaria, inclusión de diversas perspectivas, y un compromiso continuo con la reflexión crítica. Si lo logramos, los robots podrían ayudarnos no solo a realizar tareas prácticas, sino también a construir una sociedad más justa, empática y consciente de sus valores fundamentales.